Mientras esperamos a ver qué es capaz de hacer Bard, la inteligencia artificial conversacional de Google que próximamente estará integrada en su buscador, Open AI y Microsoft vuelven a dar que hablar con Chat GPT 4, la nueva versión de su aclamado chatbot.

Apenas ha pasado unos meses desde que la versión 3.5 hiciera que esta inteligencia artificial saltara a los titulares de numerosos medios de comunicación y ya tenemos una nueva iteracción que promete ser (cómo no) mucho más inteligente.

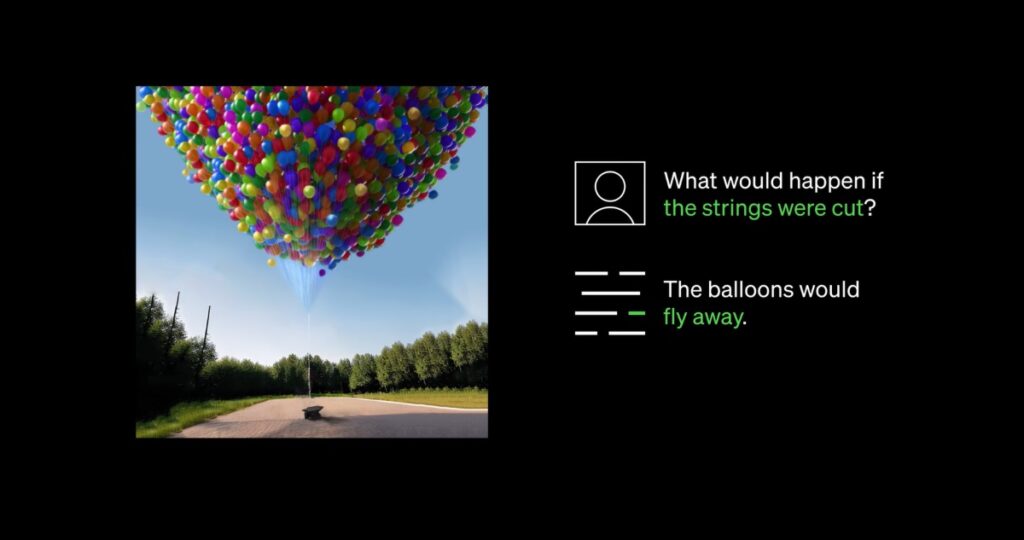

Sus creadores aseguran que “puede resolver problemas difíciles con mayor precisión, gracias a su conocimiento general más amplio y sus mayores capacidades”. Pero es que además ahora es capaz de procesar información de imágenes (fijas o en movimiento) e interpretarlas, con lo cual las posibilidades de utilización parecen ampliarse exponencialmente.

De momento GPT 4 sólo está disponible para programadores y los usuarios de ChatGPT Plus, la versión de pago de la aplicación. Por ello no hemos podido probarlo (que es lo que nos hubiera gustado hacer), pero sí hemos investigado un poco para tratar de descubrir qué es lo que ofrece la nueva versión y qué se puede hacer con ella.

¿Qué es ChatGPT 4?

Se trata, como ya hemos comentado, de la nueva versión del chatbot conversacional de Open AI. Un sistema de inteligencia artificial diseñado para mantener conversaciones a través de texto escrito de una manera mucho más racional que lo que se había visto hasta ahora.

Es por ello que en apenas unos meses haya dado muchísimo que hablar alrededor de algunas de sus posibles aplicaciones y, cómo no, también ha abierto la veda sobre sus usos en ciertos entornos o sobre si nos podemos fiar de los textos que escribe.

Un debate que seguro se va a reabrir ahora que ya se empiezan a ver las posibilidades de la cuarta versión, que como decimos no solo promete ser más inteligente y ofrecer un comportamiento más humano, sino que también puede trabajar con imágenes analizándolas e interpretándolas.

OpenAI dice haber pasado seis meses trabajando en la esta nueva versión de GPT para dotarla de mayor creatividad y menos sesgos. Es decir, han tratado de resolver uno de los aspectos más criticados de GPT-3, que se inventaba cosas cuando no encontraba información.

En cuanto a la complejidad de los resultados, sus creadores afirman que “las diferencias entre GPT-3,5 y GPT-4 pueden ser sutiles en una charla sencilla, pero realmente se notan cuando la dificultad de la tarea que se le encomienda alcanza un punto determinado».

¿Cuántos parámetros tiene ChatGPT?

La anterior versión del chatbot funcionaba en base a más de 175 millones de parámetros. Es difícil saber con cuantos parámetros funciona la versión 4, porque Open AI no ha dado ese dato, pero podemos imaginar que la cantidad se ha multiplicado exponencialmente.

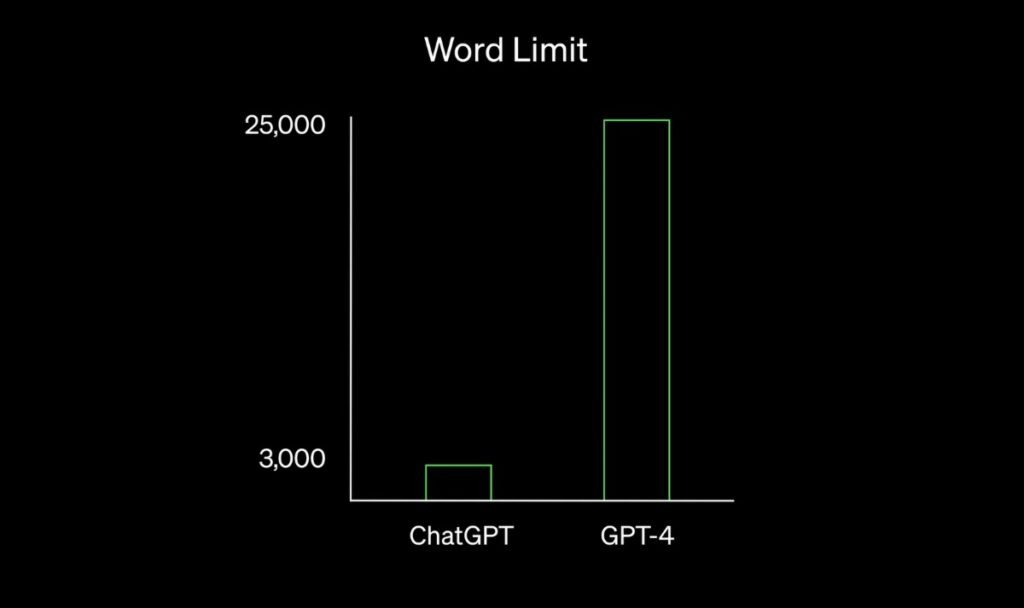

Por otro lado, también se ha eliminado el límite de tres mil palabras que la anterior versión podía ofrecer en sus respuestas, llegando ahora a la nada desdeñable cifra de 25 mil palabras. Es decir, ChatGPT es ahora mucho más “hablador” en su cuarta versión, además de inteligente y “humano”.

¿Qué se puede hacer con ChatGPT 4?

Según cuentan en LinkedIn Noticias, el nuevo GPT 4 “traduce imágenes a código, resume conferencias, describe fotos y documentos, y responde dudas con naturalidad”. Lo cierto es que, aparte de esta humanización, sí que parece traer muchas posibilidades como nos cuenta este experto en el vídeo de abajo:

@paugarciamila La revolución que viene con GPT4 🤪🤯#aprendecontiktok #apps #trucos #lifehacks #inteligenciaartificial #tecnologia ♬ sonido original – Pau Garcia-Milà

Las opciones son muchas y muy variadas como cuenta la propia OpenAi en este hilo de Reddit en donde habla de para qué está usando la gente GPT 4. Entre otras, mencionan aplicaciones tan llamativas como una que hace de ojos para personas invidentes o cosas como un usuario que le enseñó al chatbot una foto de lo que contenía su nevera y Chat GPT 4 le sugirió recetas para elaborar con esos ingredientes.

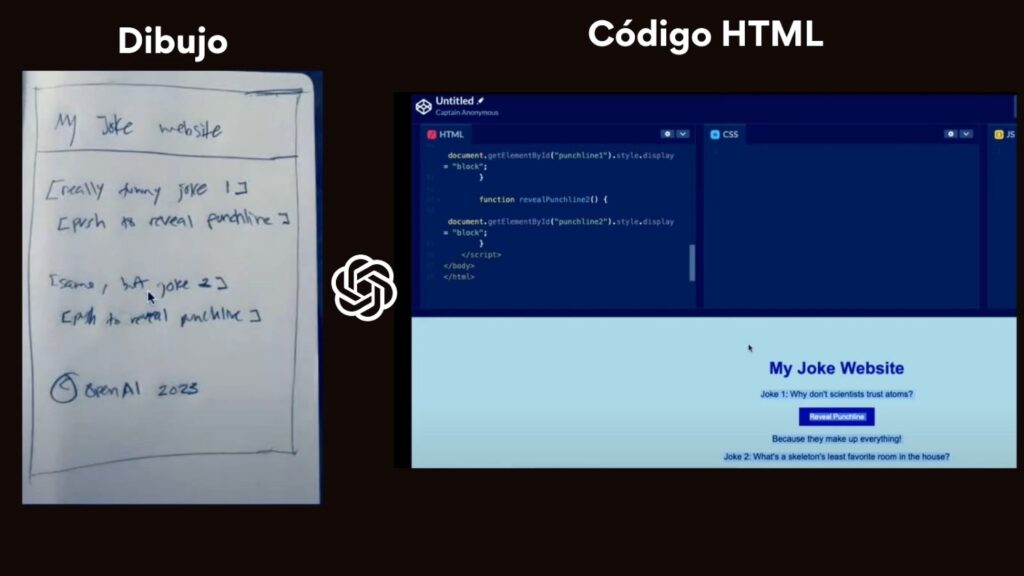

Por supuesto, no faltan también ejemplos en los que la herramienta se ha usado para generar código (uno de los usos más recurrentes). De hecho, la posibilidad de interpretar imágenes llega al punto de que es capaz de analizar una web y tratar de programarla.

O también, como cuenta este otro programador (y lo ejemplifica en la foto de arriba), GPT-4 puede leer un dibujo con el boceto que has realizado de una web y, a partir de él, crear el HTML y CSS de la página.

Sabiendo, como hemos dicho, interpretar imágenes, el nuevo chatbot no sólo detecta lo que aparece en ellas y es capaz de interpretarlo sino que tiene la “chispa” suficiente para detectar cosas inconexas o sin sentido. Es el caso que cuentan en este otro hilo de Reddit donde hablan de cómo ChatGPT 4 fue capaz de encontrar el sinsentido a un enorme y obsoleto conector VGA que en realidad escondía un pequeño puerto de carga lightning para un iPhone.

Google contraataca con Bard y Workspace

Claro que ChatGPT-4 no es la única novedad en cuanto a aplicaciones de la inteligencia artificial que hemos conocido esta misma semana. Tal y como ya ocurrió con Bard, Google ha querido quitar protagonismo a Microsoft y OpenAI anunciando su propia idea, en este caso aplicar la IA a Google Workspace.

En concreto, han anunciado nuevas funciones para Google Docs y Gmail, pensadas para que la IA desarrollada por el gigante del buscador ayuden a la gente a funciones como resumir correos electrónicos, crear borradores de mensajes, reescribir mails para darles un tono concreto, responder de manera inteligente a mensajes recibidos o asignar prioridades a los correos entrantes.

Según sus desarrolladores, la IA que se va a integrar en Gmail será capaz de detectar el contexto de lo que se quiere escribir a partir de una lista de puntos destacados que le entreguemos.

Por lo que toca a Google Docs, las nuevas funciones de inteligencia artificial servirán para muchas cosas: redactar documentos a partir de unas ideas generales, realizar un resumen de un texto, reescribir o corregir textos ya redactados o hacernos un brainstorming sobre un tema determinado.

Por supuesto esto es solo el principio ya que prometen agregar estas capacidades a muchos otras aplicaciones de Workspace, para ofrecer herramientas en las que se puedan hacer cosas de mayor calidad pero de manera más sencilla.

Por supuesto esto es solo el principio ya que prometen agregar estas capacidades a muchos otras aplicaciones de Workspace, para ofrecer herramientas en las que se puedan hacer cosas de mayor calidad pero de manera más sencilla.

Está claro, tendremos inteligencia artificial, ya sea con GPT 4 de Open AI, con Bard de Google o con cualquier otra, para aburrirnos.

Imágenes | Fotos de Adobe Stock, OpenAI y Miguel Ángel Durán García