Pablo Lanillos en el Instituto de Sistemas Cognitivos de la Universidad Tecnológica de Múnich (Alemania). / ICS-TUM

En un futuro, cuando sea habitual la convivencia con robots humanoides, será esencial que estos sean capaces de distinguir entre las máquinas y los humanos y, para ello, es imprescindible que antes puedan tener conciencia de su propio cuerpo. Solo de esta forma podrán cumplir la novena ley robótica definida por la experta Laurence Devillers como la obligación de nuestros compañeros metálicos de evitar el riesgo de confusión entre ellos y las personas de carne y hueso. Enseñar a los robots a autopercibirse en el objetivo del trabajo liderado por el español Pablo Lanillos, desde de la Universidad Tecnológica de Múnich. El proyecto, denominado Selfception, está financiado por la Unión Europea a través de una beca Marie Curie.

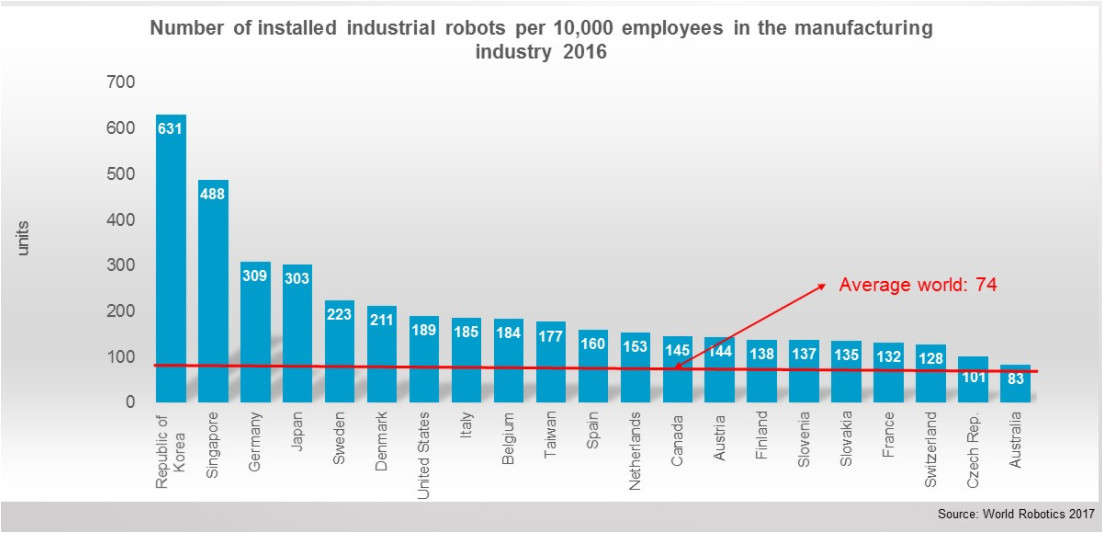

La autopercepción del propio cuerpo por parte de los robots permitirá mejorar su inteligencia artificial, garantizando una interacción más segura entre humanos y máquinas, algo fundamental para el futuro que se avecina. Según la Federación Internacional de Robótica, la automatización de la producción se está acelerando en todo el mundo: en la actualidad ya hay 74 unidades robóticas por cada 10.000 empleados en el mundo y este proceso crecerá de forma imparable por el desarrollo tecnológico. Los 11 países más automatizados del mundo son: Corea del Sur, Singapur, Alemania, Japón, Suecia, Dinamarca, EE. UU., Italia, Bélgica, Taiwán y España. En cuanto a robots no industriales, se calcula que hay unos 35 millones en todo el planeta.

Garantizar una convivencia asegura entre los humanos y las máquinas que vendrán es el objetivo del trabajo de Pablo Lanillos, que trata de crear un modelo que permita a los robots aprender a reconocer su propio cuerpo y distinguirlo de otros elementos del entorno. «La evidencia reciente sugiere que la distinción entre uno mismo y otro será un gran avance para mejorar la interacción y podría ser la conexión entre las habilidades sensomotoras de bajo nivel y las acciones voluntarias, o incluso el pensamiento abstracto», afirma el investigador. Para ello, propone combinar el aprendizaje sensomotor avanzado con nuevos dispositivos como la piel artificial, para permitir que el robot adquiera su representación perceptiva.

La robotización y la mano de goma

El objetivo del proyecto Selfception es que los robots puedan responder a la pregunta: “¿Es este mi cuerpo?”. Para ello, se está utilizando una técnica de aprendizaje basada en la ilusión de la mano de goma. «Este famoso test se utiliza para estudiar cómo los humanos procesamos la información sensorial. Con él se descubrió que la percepción de nuestro cuerpo es muy plástica y casi instantánea: en menos de un minuto te pueden hacer creer que una mano que no es tuya lo es. Esto lo aplicamos en un robot –llamado TUMM– con capacidad de visión, tacto y de sentir su brazo a través de sensores», explica Pablo Lanillos a SINC.

«Por supuesto -añade- al robot no le podemos preguntar si cree que su mano es suya o dónde la siente. Lo que hicimos fue un experimento con personas para ver cuánto se desplazaba porcentualmente el eje corporal si poníamos la mano de plástico a distintas distancias. Repetimos el ejercicio con el robot y comprobamos que los gráficos seguían un mismo patrón. De momento es un modelo simplificado, que iremos complicando con redes neuronales».

La hipótesis de Lanillos es que existen unos patrones que no reflejan el conocido yo reflexivo (“pienso, luego existo”), sino que subyacen de forma inconsciente y ayudan a identificar el propio cuerpo. Segun el investigador, se trata de un yo sensomotor, cuyo aprendizaje, más allá de su uso en la robotización, permitirá su aplicación en la aceptación de prótesis o el tratamiento de trastornos neurobiológicos donde interviene el «yo», como la esquizofrenia y el autismo.