Un equipo de investigadores del MIT ha desarrollado una nueva tecnología capaz de transcribir palabras que el usuario verbaliza internamente, pero que en realidad no ha pronunciado en voz alta.

Los electrodos en el dispositivo captan señales neuromusculares de la mandíbula y en la cara que se desencadenan mediante verbalizaciones internas, es decir, »hablando mentalmente». Estas señales se alimentan a un sistema de aprendizaje automático de inteligencia artificial (IA), entrenado para correlacionar señales particulares con palabras concretas.

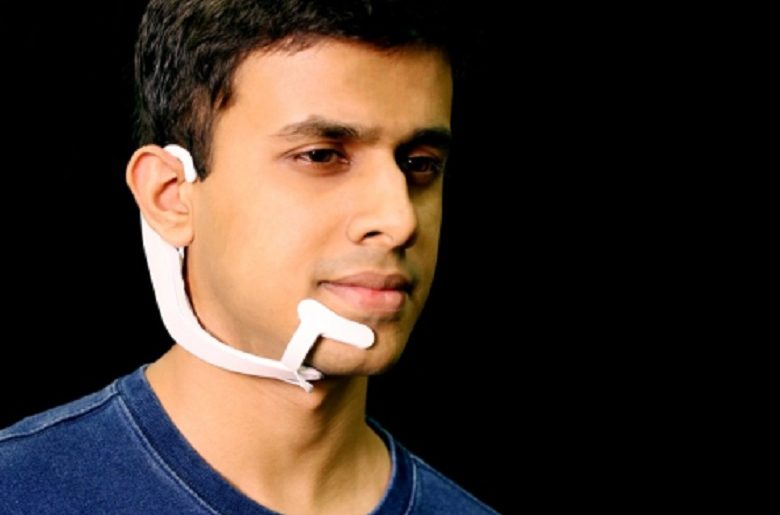

Este innovador dispositivo llamado AlterEgo, impulsado por el equipo de Arnav Kapur, del Instituto Tecnológico de Massachusetts (MIT), en Cambridge, Estados Unidos, incluye unos auriculares de conducción ósea, que transmiten vibraciones a través de los huesos de la cara hacia el oído interno. Dado que no obstruyen el canal auditivo, los auriculares permiten que el sistema transmita información al usuario sin interferir en su captación de sonidos externos.

más cerca de la fusión entre humanos y máquinas

«La motivación fue construir un dispositivo de IA. Nuestra idea era: ¿Podríamos tener una plataforma informática que favorezca una fusión entre humanos y máquinas, de manera que podamos considerarlas una extensión de nuestra propia cognición?», ha planteado Arnav Kapur a través de un comunicado.

Por su parte, Pattie Maes, profesora de arte y asesora de la tesis de Kapur, ha explicado que a día de hoy no podemos vivir sin nuestros smartphones y, en general, nuestros dispositivos digitales. »Cuando queremos buscar algo que sea relevante para una conversación que estoy teniendo, tenemos que buscar móvil y escribir el código de desbloqueo, abrir una aplicación y escribir una palabra clave de búsqueda. Todo ello requiere que cambie completamente la atención de mi entorno y las personas con las que estoy para dedicársela al smartphone», ha destacado.

la revolución de alterego

Sin embargo, el sistema AlterEgo ofrece una experiencia que permite a las personas beneficiarse de todos los conocimientos y servicios que nuestros dispositivos nos brindan, pero sin necesidad de desviar toda nuestra atención.

En definitiva, se trata de un sistema de computación con interfaz silenciosa que permite al usuario plantear y recibir, de forma indetectable para terceras personas, respuestas a problemas del tipo de los que normalmente se le dan a resolver a ordenadores. Por ejemplo, en uno de los experimentos los participantes usaron el sistema para informar silenciosamente de los movimientos de su oponente en una partida de ajedrez, y de la misma manera, recibir recomendaciones sobre la mejor jugada realizable contra el adversario también de manera silenciosa, tal como han publicado en NCYT.

verbalización interna

La verbalización interna, o «subvocalización», como interfaz computacional es un terreno mayormente inexplorado. El primer paso de Kapur y el resto de su equipo investigador fue determinar qué puntos de la cara son el origen de las señales neuromusculares más fiables. A partir de ahí, llevaron a cabo experimentos en los que se pidió a los mismos sujetos subvocalizar las mismas series de palabras cuatro veces, con un conjunto de 16 electrodos situados en diferentes ubicaciones faciales en cada ocasión.

Después, los investigadores escribieron un programa para analizar los datos resultantes y encontraron que las señales de siete ubicaciones particulares de los electrodos permitían distinguir de forma reiterada palabras subvocalizadas. La tecnología vuelve a sorprendernos, en este caso abordando un terreno tan sorprendente como desconocido: dispositivos que leen nuestra mente.