Un nuevo proyecto de DeepMind demuestra cuánto le cuesta a la tecnología más innovadora ponerse al nivel de los humanos, incluso desde su más tierna infancia. Y lo ha hecho configurando una inteligencia artificial con algunas de las herramientas de razonamiento de un recién nacido.

Plato ha sido desarrollado por DeepMind, compañía que investiga en el campo de la inteligencia artificial gracias a los recursos de Alphabet. La novedad de este algoritmo, capaz de predecir el resultado de algunas situaciones y hasta ‘sorprenderse’ de que sus planes se tuerzan, es que está inspirado en la cognición de bebés de tres meses.

¿Puede que la inteligencia artificial sea poco inteligente?

Aunque no suponga una sorpresa especial para padres y madres, hay estudios que demuestran que ya desde los pocos meses un bebé es capaz de reaccionar con sorpresa cuando una situación desafía a la lógica. Por ejemplo, al presenciar pequeños trucos de magia o si ve que una pelota pasa por detrás de una superficie opaca y no continúa su camino tras ella.

Esta habilidad para predecir qué ocurrirá en ciertas situaciones de lo más cotidianas, algo que los seres humanos hacemos de manera continua y sin que nos cueste aparentemente ningún esfuerzo, puede parecer básica. Pero no lo es; tanto que para las máquinas, incluyendo a sofisticadas inteligencias artificiales cuya programación ha requerido un gigantesco presupuesto, supone un enorme desafío.

Hay figuras de renombre que consideran a las inteligencias artificiales poco menos que una amenaza existencial para la humanidad, pero otras se resisten a mostrarse tan categóricas. Es el caso de Yoshua Bengio, galardonado con el premio Princesa de Asturias de Investigación Científica y Técnica y considerado como un referente en el aprendizaje automático o machine learning, quien las considera, en realidad, “tontísimas”.

Así funciona Plato, el nuevo algoritmo de DeepMind

Tampoco hay que ser crueles con las pobres IAs: son capaces de hacer cálculos complejísimos en milisegundos. Al mismo tiempo, eso sí, se les resiste lo que conocemos como ‘física intuitiva’, unas nociones básicas de cómo funciona el mundo que hasta a un bebé le permiten deducir que si sueltas un objeto este se caerá al suelo o, más aparentemente simple aún, que el agua moje.

Es este aspecto, específicamente, en el que se ha volcado DeepMind, la empresa centrada en inteligencias artificiales que compró Alphabet, Inc., matriz de Google, allá por 2014. Para ello, ha ideado un modelo computacional capaz de entender ciertos comportamientos físicos básicos a partir del procesamiento de animaciones visuales. En lenguaje llano, tal como haría un humano: observando su entorno.

La sorprendente conclusión del equipo responsable del proyecto es que la máquina aprende mucho mejor siguiendo los pasos de un bebé de pocos meses. Para ello, argumentan en un artículo publicado por la revista especializada ‘Nature Human Behaviour’, partieron de los postulados de varios estudios de psicología del desarrollo sobre la cognición de los niños pequeños.

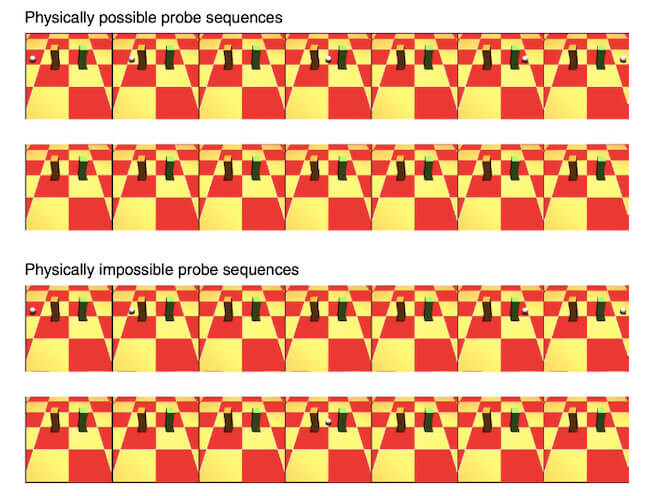

La IA que se ‘enfada’ cuando algo no sale bien

En DeepMind enseñaron a su algoritmo hasta 28 horas de vídeos, con ejemplos de pelotas en movimiento. Tras el visionado y el entrenamiento, Plato podía prever, por ejemplo, dónde y cuándo tendría que reaparecer la bola al pasar por detrás de un cajón. Es decir, que empezó a ser capaz de generar expectativas y entender cualidades como la continuidad y la solidez de un objeto.

Para los investigadores, el entrenamiento visual contribuyó de manera definitiva en el proceso de aprendizaje, dotando a la inteligencia artificial de estas nociones de física intuitiva. De hecho, compararon sus resultados con los de otros algoritmos que tenían que aprender dichas reglas de cero, demostrándose que puntuaban mucho mejor partiendo del conocimiento previo.

Uno de los momentos más curiosos fue cuando el equipo le mostró otros vídeos con escenas imposibles, como una pelota atravesando una mesa. Imitando el comportamiento de un bebé, Plato también reaccionó ‘sorprendiéndose’ ante lo que consideraba absurdo. Aunque fuera a través de píxeles, la máquina se quedaba estupefacta como si hubiese presenciado un truco de magia.

¿Pueden las máquinas tener sentido común?

A pesar de que Plato estaba entrenado con un conjunto muy pequeño de animaciones visuales, al menos si lo comparamos con el que puede absorber un recién nacido a través de sus sentidos, reaccionó generando expectativas ante lo que tendría que suceder. Las implicaciones de este trabajo para el futuro de la investigación en el campo de las inteligencias artificiales son importantes.

Especialmente por su aproximación a la psicología evolutiva. Expertas del departamento de Psicología de la Northwestern University, que han revisado el proyecto antes de su publicación, subrayan que el trabajo de DeepMind evalúa qué experiencias perceptuales son necesarias para explicar conocimientos evidentes en un bebé. Puede parecer ciencia ficción, pero la investigación en redes neuronales ayudará a estudiar cómo los pequeños aprenden.

En Nobbot | Un neurocientífico enseña a unas ratas a jugar al ‘Doom’

Imágenes | Portada: fotografía de Andrea De Santis en Unsplash. Interiores: gráfico del paper de Deepmind y fotografía de Yuri Shirota en Unsplash.